Abstract & Introduction

What ABSA?

- 传统的情感分析任务假设是整个文本是具有整体极性,也就是一个句子就表示一种情感倾向。但实际工作中,用户的评论可能包含不同的方面,例如:“这本书是精装版,但价格有点高。” 书的“外观”的极性为正,“价格”的极性为负。因此诞生了一个新的任务,基于方面的情绪分析(ABSA)。ABSA任务的操作步骤是 (1)确定表达情感的每个目标; (2)确定每个目标的情感极性。

本文贡献?

- 基于ABSA任务转换成句子对任务

- 例如其中一种转换方式:

- 原句:“LOCATION1 is central London so extremely expensive”

- 可能的一个辅助句:“what do you think of the price of LOCATION1”

- 例如其中一种转换方式:

- 微调BERT模型,提升在SentiHood 和 SemEval2014 Task 4 数据集上的效果。

- 基于ABSA任务转换成句子对任务

作者已开源:点我🤐

本人复现了部分实验:点我🤐

Methodology

任务描述

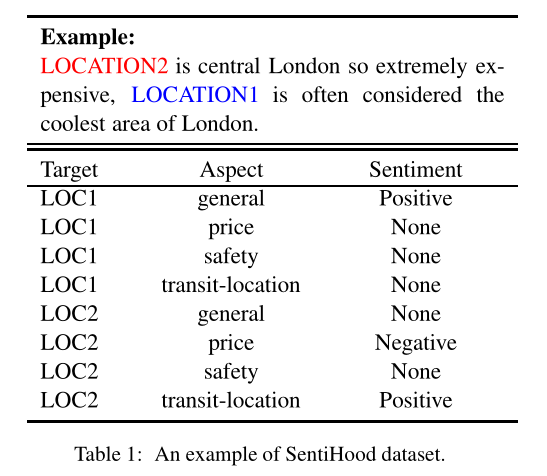

TABSA

$$

给定有m个单词的句子s= {w_{1}, w{2},…,w_{m}},句子s中包括k个目标实体T={t_{1},t_{2},…,t_{k}}

$$

$$

以及固定的属性集合 A = {general, price, transit-location, safety}

$$

$$

预测每一个情感实体T映射到每一个属性集合A的情感极向y \in {positive, negative, none}

$$

例如:

ABSA

semeval2014\task4\subtask3

$$

给定有m个单词的句子s= {w_{1}, w{2},…,w_{m}}, 以及属性集合A={a_{1}, a_{2},…,a_{k}},预测句子s中有哪些属性

$$

For example, given the set of aspect categories {food, service, price, ambience, anecdotes/miscellaneous}:

“The restaurant was too expensive” → {price}

“The restaurant was expensive, but the menu was great” → {price, food}

semeval2014\task4\subtask4

$$

给定有m个单词的句子s= {w_{1}, w{2},…,w_{m}}, 以及属性集合A={a_{1}, a_{2},…,a_{k}}

$$

$$

以及情感极向Y={y_{1}, y_{2},…,y_{k}},预测句子s中有哪些属性以及这些属性的情感极向

$$

Given a set of pre-identified aspect categories (e.g., {food, price}), determine the polarity (positive, negative, neutral or conflict) of each aspect category.

For example:

“The restaurant was too expensive” → {price: negative}

“The restaurant was expensive, but the menu was great” → {price: negative, food: positive}

构造辅助句子

- QA-M (三分类):

- 对每个属性生成一个句子,预测情感极向 positive、negative或none

- pair (LOCATION1, safety), the sentence we generate is “what do you think of the safety of location - 1 ?”

- NLI-M (三分类):

- 对每个属性生成一个句子,预测情感极向 positive、negative或none

- pair (LOCATION1, safety), the sentence we generate is “location - 1 - safety”.

- QA-B (二分类):

- 对每个属性生成三个情感极向的句子,预测yes 或 no

- pair (LOCATION1, safety)

- the polarity of the aspect safety of location - 1 is positive

- the polarity of the aspect safety of location - 1 is negative

- the polarity of the aspect safety of location - 1 is none

- NLI-B (二分类):

- 对每个属性生成三个情感极向的句子,预测yes 或 no

- pair (LOCATION1, safety)

- location - 1 - safety- positive

- location - 1 - safety- negative

- location - 1 - safety- none

微调BERT实现

用BERT中最后一层隐藏层的第一个token(以 [CLS]作为输入的token)作为输出,接入一个(n*k)的全连接层做k分类预测

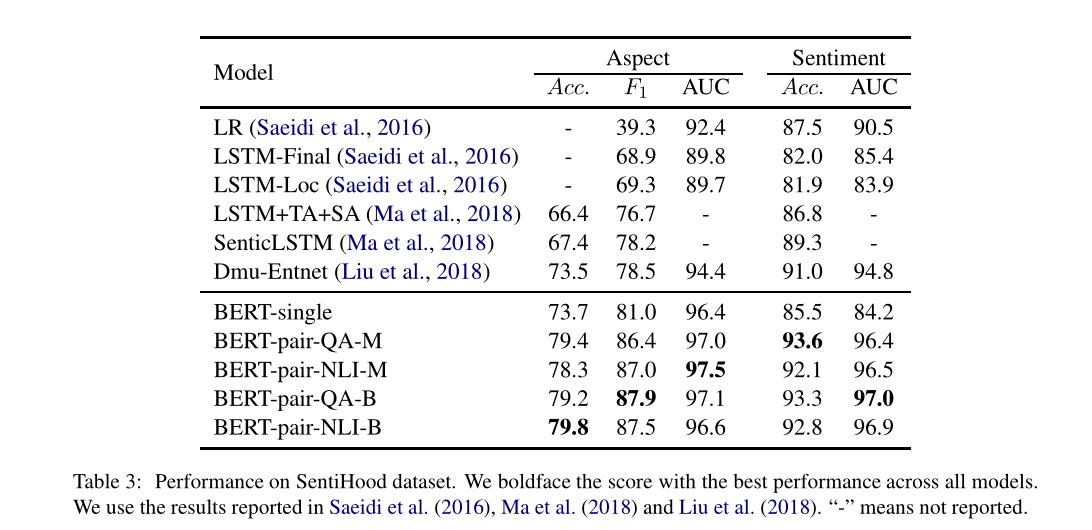

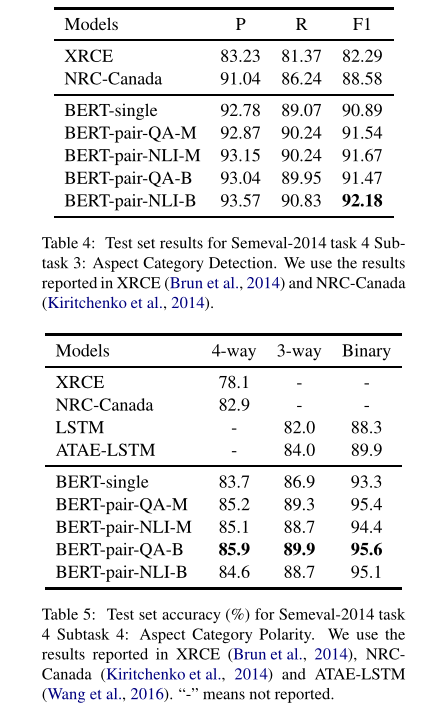

Experiments

数据集

SentiHood

https://github.com/uclmr/jack/tree/master/data/sentihood

SemEval-2014-Task 4 - subtask3 & 4

http://alt.qcri.org/semeval2014/task4/

结果

Discussion

为什么作者提出的BERT-pair在这两个任务上表现的好呢?

- 将目标和方面信息转化为辅助句子其实是拓展了数据集

- 由于BERT预训练时的特性,它适合做句子对分类的任务,然而作者提出的这种信息转化实际上提高了BERT的理解能力